‘AI is een hamer en alles wordt ineens een spijker’

De overheid gebruikt steeds vaker AI, van chatbots tot besluitvorming. Maar wat betekent dat eigenlijk voor de relatie tussen overheid en burger? En hoe (on)gewenst is dat? Daarover ging de paneldiscussie tijdens de Gebruiker Centraal-conferentie ‘Eén mensvaardige overheid: een kwestie van doen’.

Renata Verloop, voor Gebruiker Centraal een zeer bekend gezicht, leidde de paneldiscussie. In het panel zaten:

- Eva de Valk (kwartiermaker digitalisering bij Nationale Ombudsman)

- Wiep Hamstra (informatiestrateeg bij ministerie van Algemene Zaken)

- Nelleke Groen (tech-jurist bij Rijkswaterstaat)

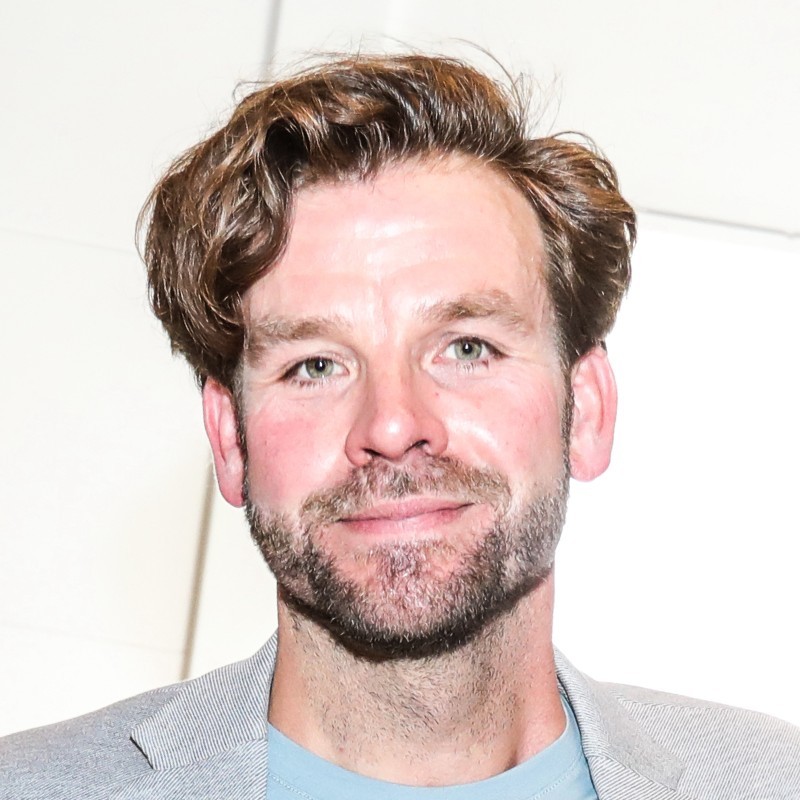

- Laurens Vreekamp (journalist, trainer en oprichter Future Journalism Today Academy)

Meer over Eva, Wiep, Nelleke en Laurens

Eva de Valk is kwartiermaker digitalisering bij De Nationale Ombudsman. In die rol verkent zij hoe de ombudsman zijn rol het beste kan vervullen in het digitale tijdperk. Haar loopbaan is gericht op de maatschappelijke impact van digitalisering, specifiek vanuit burgerperspectief. Eerder werkte zij bij het ministerie van BZK aan beleid voor digitale inclusie. Daarvoor werkte zij als techjournalist voor o.a. NRC en NOS en was zij correspondent in Silicon Valley.

Wiep Hamstra werkt als contentstrateeg bij het ministerie van Algemene Zaken (Dienst Publiek en Communicatie). Ze is expert op het gebied van ICT, overheidsdienstverlening en -communicatie. Ze onderzoekt en beschrijft hoe organisaties AI inzetten voor taal, toegankelijkheid en chatbots, met nadruk op duidelijke communicatie, zorgvuldig gebruik van tekstgeneratietools en de grenzen en risico’s van conversational AI.

Nelleke Groen is tech-jurist bij Rijkswaterstaat en gespecialiseerd in de juridische en ethische aspecten van AI, data en cybersecurity binnen de rijksoverheid. Vanuit haar achtergrond in privacy en mensenrechten adviseert zij over de verantwoorde inzet van algoritmes en AI-systemen in publieke besluitvorming. In het panel brengt zij een scherp juridisch en governanceperspectief op AI in de overheid.

Laurens Vreekamp is journalist, trainer en oprichter van de Future Journalism Today Academy. Hij schreef de boeken ‘The Art of AI’ en ‘Niet onze AI’, waarin hij laat zien hoe AI keuzes, verhalen en machtsverhoudingen beïnvloedt. In zijn werk helpt hij redacties en makers om voorbij de hype na te denken over de kansen, risico’s en grenzen van AI.

“Als je in één woord zou moeten omschrijven hoe je jezelf tot AI verhoudt, welk woord zou dat dan zijn?”, gooit Renata als eerste vraag erin. De antwoorden verschillen nogal. Van ‘meisje in de speeltuin’ tot ‘ongemak’. En van ‘techno-optimist’ tot ‘atheïst’ (in een ruimte met AI-gelovers). Zo divers als het fenomeen AI is, zijn dus ook de meningen óver AI.

Intelligent contact

Hoe intelligent maakt AI het contact tussen overheid en burger eigenlijk? Dat valt vies tegen, vinden meerdere panelleden. “Bedrijven verkopen AI aan ons alsof het allemaal magisch en slim is”, begint Laurens. “Maar er zijn helaas genoeg voorbeelden dat het fout kan gaan. Laatst nog bijvoorbeeld met Peter Vandermeersch (oud-NRC-hoofdredacteur, red.).”

Vragen of AI intelligent is, is volgens Wiep als vragen of cup-a-soup soep is. “Nee, het is gewoon poeder in een zakje. En AI is niet intelligent. Trouwens, AI bestaat al heel lang. Voor het grote publiek is het alleen nieuw en innovatief. Maar dat komt vooral door de uitnodigende interface van bijvoorbeeld ChatGPT.”

Bekvechtende AI-bots

De Nationale Ombudsman merkt dat AI steeds vanzelfsprekender is voor burgers. Eva: “We zien dat klachten steeds vaker worden geformuleerd met hulp van AI. Mensen krijgen ook steeds vaker advies van AI en wijken daar niet snel van af. Ook als dit advies eigenlijk helemaal niet klopt.”

Dat is lastig, merkt Eva. “Als we bellen met iemand die een klacht heeft, dan weet diegene vaak helemaal niet wat voor klacht-ie precies heeft ingestuurd. Het is veel werk om beweringen en feiten uit dit soort klachten te controleren.”

“Is AI-gebruik van burgers niet ook een reactie op de complexe manier van communiceren vanuit de overheid?”, klinkt het kritisch uit het publiek. Daar hoeft Eva niet lang over na te denken: “Jazeker, dat is zo. En zo kom je in een vicieuze cirkel terecht. Je wilt voorkomen dat contact tussen burger en overheid eindigt in een stel bekvechtende AI-bots.”

Verkeerde inschatting

Een ander risico volgens Eva: “Als overheid kun je door AI de vaardigheden van burgers ook verkeerd inschatten. Iemand gebruikt bijvoorbeeld AI om een klacht te formuleren en lijkt daardoor heel welbespraakt. Terwijl diezelfde persoon in bijvoorbeeld telefonisch contact veel minder makkelijk uit z’n woorden weet te komen.”

Andersom wordt AI ook gebruikt om moeilijke taal makkelijk te maken. Draagt AI in de praktijk dus ook bij aan meer inclusie? Nee, dat is te makkelijk gedacht, vindt Nelleke: “Inclusie betekent niet dat burgers met hulp van AI nu ook taalvaardiger kunnen worden richting de overheid. Het werkt juist andersom: de overheid moet de stap naar mensen toe zetten. Bijvoorbeeld door begrijpelijker te communiceren.”

Homogene brij

Ook Wiep kan niet echt enthousiast worden van AI om (meer begrijpelijke) teksten te produceren. “Ik zie niet zo veel in synthetische teksten. Het is namelijk homogene brij. Bovendien, als je AI gebruikt, dan heb je niet echt engagement met de tekst.”

Daar is Nelleke het mee eens: “Ik heb helemaal geen zin om te checken of een tekst die AI me voorschotelt klopt. Dan kan ik net zo goed zelf de tekst schrijven. Ik wil zélf de lijn van argumentatie uitzetten. En ik wil zelf ook het denkwerk doen. Dat is namelijk onmisbaar voor schrijven.”

Shiny object syndrome

Een ander gevaar van AI volgens Laurens: de kans dat een tekst verkeerd geïnterpreteerd wordt. “Die kans is groot. De burger moet volgens mij zekerheid kunnen verwachten van de overheid. Terwijl AI alleen waarschijnlijkheid geeft. Best gek toch? We kiezen deze oplossing (AI en waarschijnlijkheid, red.) vóór zekerheid.”

Dat is nergens voor nodig, vindt Laurens: “Voor de meeste problemen zijn er al allerlei low-tech oplossingen beschikbaar. AI is wat dat betreft een goed voorbeeld van het shiny object syndrome.” Dit is een term die omschrijft hoe mensen al snel een (te rooskleurige) focus hebben op nieuwe ontwikkelingen. Nelleke deelt de mening van Laurens: “Er is binnen de overheid heel veel onder de paraplu van ‘AI’ geschoven om maar budget te krijgen voor een nieuw project.”

Dat er veel kritiek is op de AI-hype, is logisch. “Maar”, oppert Eva, “ik wil niet dat we daardoor bij voorbaat álle tools van tafel vegen. ‘AI’ is namelijk een heel breed begrip. En AI-achtige toepassingen kunnen helpen om te ‘doen wat behoorlijk is’.” Eva verwijst daarmee naar de behoorlijkheidswijzer van de Nationale Ombudsman.

AI voor proactieve dienstverlening

Een vraag uit het publiek: kan AI ook bruikbaar zijn voor proactieve dienstverlening? “Er is een onderscheid tussen discriminative AI en generative AI (zie kader hieronder, red.)”, begint Laurens. “Voor proactieve dienstverlening zou het dan gaan om die eerste categorie. Dat klinkt als een neutrale oplossing, maar techniek is niet neutraal. AI gebruiken voor proactieve dienstverlening is dus een risico.”

Techniek zorgt daarnaast voor digitale ongelijkheid, benadrukt Laurens. Iets waar Wiep het mee eens is: “Neem bijvoorbeeld DigiD, waar je een telefoon voor nodig hebt. Maar als je een gezin bent en niet iedereen heeft een telefoon, dan kan niet iedereen in dat gezin DigiD gebruiken.”

Meer dan alleen ‘dom’ of ‘slim’

Wat Wiep ook opvalt, is dat bij de discussie over AI er te veel aan een enkele as wordt gedacht. Met aan de ene kant de niet-gebruikers van AI, die automatisch ‘dom’ zijn omdat ze de efficiëntie en kansen laten liggen. En aan de andere kant de AI-gebruikers, die dus automatisch ‘slim’ zijn omdat zij wél AI benutten. “Maar zo simpel is het niet. Want niet-gebruik heeft ook voordelen. En gebruik van AI heeft ook nadelen. Er moet dus eigenlijk nog een as bij, zodat er 4 kwadranten ontstaan.”

Die voor- en nadelen verschillen ook per soort AI dat je gebruikt. Een mooi moment voor Renata om er een stelling in te gooien ‘De overheid zou alleen ‘ouderwetse’ AI, discriminatieve AI dus, moeten gebruiken. En niet generatieve AI.’ Daar is in de kern iedereen het mee eens.

Alles wordt een spijker

“Het heeft een voordeel om je brein te blijven gebruiken. Net zoals het een voordeel heeft om in beweging te blijven. Als je de trap op kunt lopen, blijf dit dan doen”, adviseert Nelleke.

Laurens vult aan: “Er is door AI-aanbieders een vals frame ontstaan: AI is een hamer en alles wordt ineens een spijker. Maar: wat wil de gebruiker nou werkelijk? Dan is het antwoord niet heel technisch. De gebruiker had en heeft juist heel menselijke, basale behoeften. Zoals gehoord worden en geliefd zijn. De vraag die we dus moeten stellen is: in hoeverre helpt deze technologie bij onze basisbehoeften?”

De tijd nemen

Veel liever ziet Laurens dat we juist meer de tijd nemen voor dingen. “Als je bijvoorbeeld poëzie leest, ga je ook niet voor snelheid. Dan neem je de tijd voor de tekst. Zo is het ook met contact tussen mensen: neem daar de tijd voor. Stop dus geen miljoenen in de ontwikkeling van chatbots, maar steek tijd in mensen opleiden tot het voeren van échte gesprekken.”

Het publiek reageert intussen gemengd. Een deel is het er roerend mee eens, maar er komt ook een kritische vraag: AI is niet te stoppen en jongeren van nu groeien ermee op, wat kunnen de panelleden daarover zeggen? “Deze vraag kan ik eigenlijk het beste beantwoorden met heel veel vragen”, pareert Nelleke. “Want wát is niet te stoppen? Wie zijn al die jongeren? En waar gebruiken ze het dan voor?”

In de trein zitten

Laurens: “Je kunt ook vragen: waar gaat de trein heen en moet ik erin zitten? Het is niet zo dat we passief toekijken hoe dingen zich ontwikkelen. Je kunt gewoon als student in een groepje zeggen: voor dit project gebruiken we geen chatbots. En dat kun je ook afspreken op de werkvloer.”

Een andere vraag uit het publiek gaat over het verschil met de ontwikkeling van mobiele telefonie en social media. Wiep: “AI interacteert met mensen, dat is bijvoorbeeld heel anders bij de uitvinding van de boekdrukkunst. Daarnaast: anders dan mobieltjes bijvoorbeeld is AI heel erg verweven met politiek, fascisme en dat soort dingen.”

Vergeet goed of fout

Hoe we daarmee om moeten gaan? Eva: “We moeten kaders ontwikkelen voor AI-gebruik. Niet alleen voor onszelf als overheid, maar ook door burgers te begeleiden in wat wel of niet kan. Over AI moeten we een breed maatschappelijk gesprek voeren. Dit hebben we namelijk onvoldoende gedaan bij de opkomst van social media.”

Laurens verwijst tot slot naar het proportionaliteitsbeginsel: “We moeten niet in gesprek gaan over wat goed of fout is, maar over wat proportioneel is. We weten bijvoorbeeld dat bias en discriminatie voorkomt in taalmodellen. Weegt dat op tegen wat het gebruik van deze taalmodellen oplevert? Als we zo naar AI-gebruik kijken, hebben we er veel meer aan.”