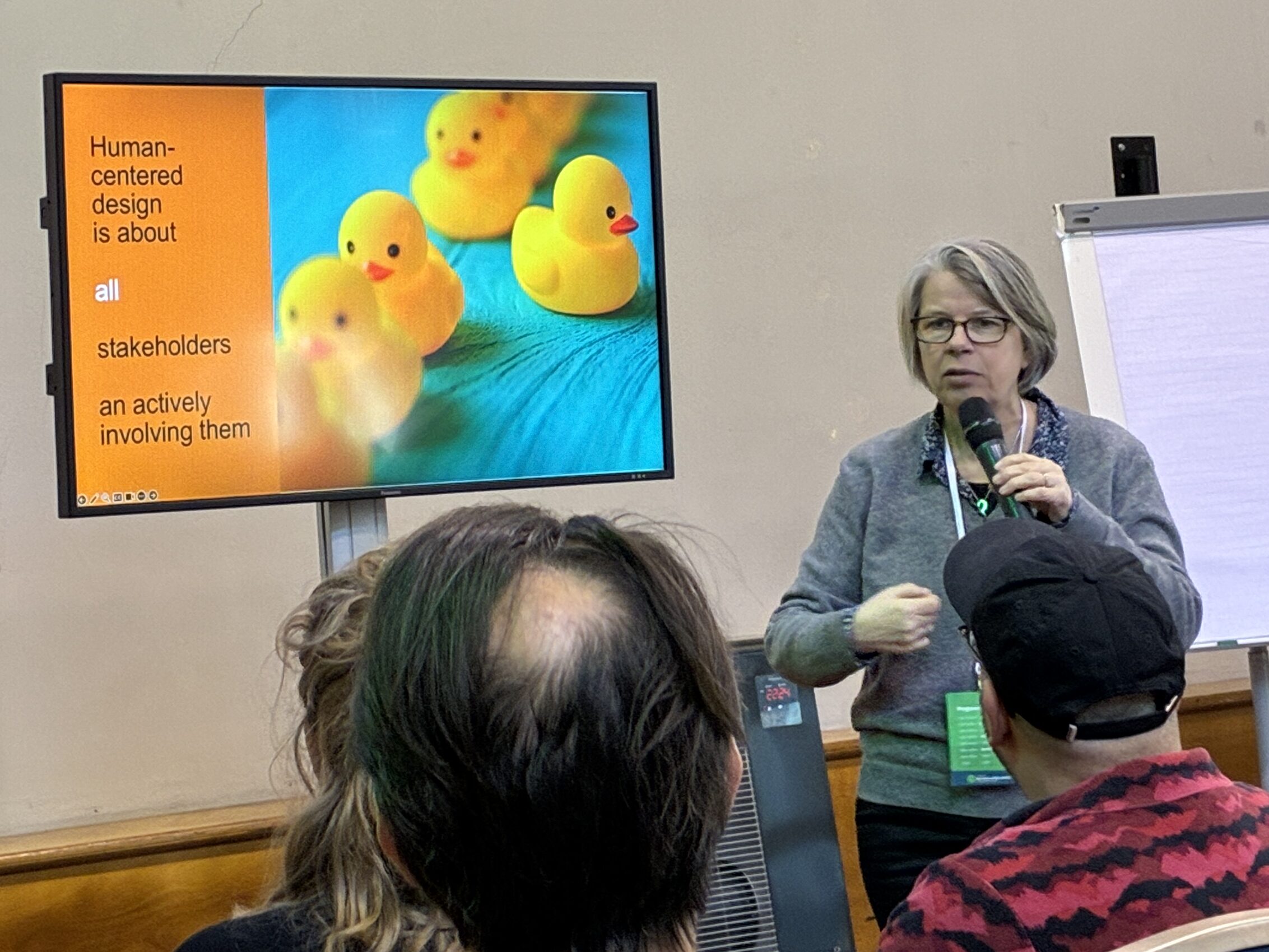

De mens en het algoritme: van vervanging tot verantwoordelijkheid

Overal om ons heen nemen algoritmen en AI-systemen beslissingen die mensen raken. In het onderwijs, bij de overheid, in dienstverlening. Vaak gaat het gesprek over wat technisch kan en wat juridisch mag. Maar over de menselijke maat gaat het zelden. Juist die maat staat centraal in het onderzoek van Aletta Smits, lector bij de Hanze Hogeschool. Ze neemt je mee op een digitale reis, van 1-op-1-vervanging van analoge systemen tot een volwaardig gesprek van mens en algoritme.

“Design is een gesprek”, begint Aletta haar verhaal. Maar een digitaal gesprek gaat net wat anders dan een normaal gesprek. Het verschil: in elk normale gesprek kun je fouten herstellen. Fouten maken we omdat we denken terwijl we spreken. In een digitaal gesprek kun je alleen meepraten of fouten verbeteren als het systeem dit mogelijk maakt. Het systeem moet hiervoor speciaal ontworpen zijn. En dat gebeurt nog te weinig. In de digitale transformatieprocessen is daar niet altijd aandacht voor.

4 vormen van digitale transformatie

Het fundamentele verschil tussen mens en machine is essentieel voor het begrijpen hoe digitale systemen werken — en hoe ze zich blijven ontwikkelen. Aletta: “Alle systemen die we introduceren, hebben te maken met digitale transformatie. In deze digitale transformatie zitten we al heel lang.” Het einde is nog niet in zicht. Aletta onderscheidt 4 vormen:

- Substitution

Een digitale vervanging, terwijl er functioneel niets verandert. Bijvoorbeeld een formulier dat op de website is gezet, 1-op-1 overgenomen. - Augmentation

Niet alleen een digitale vervanging, maar ook een verbetering. Bijvoorbeeld een formulier op de website, met uitleg bij de invulvelden. - Modification

Dit betekent echt serieuze verandering. Bijvoorbeeld het belastingformulier van de Belastingdienst, waarbij al veel gegevens van tevoren zijn ingevuld. - Redefinition

Dit is digitale transformatie tot het hoogste niveau. Een tool met nieuwe, niet eerdere bedachte kanten. Als voorbeeld noemt Aletta een avatar van iemand die overleden is. Deze ‘redefinition’ is persoonlijk. “Broers en zussen hebben iedere een eigen band met hun vader. Ze zouden dan ieder een andere avatar van hun vader ontwikkelen.”

Recommender en decision support

Deze 4 vormen laten zien hoe groot de impact van digitalisering kan zijn. Maar hoe werken die systemen dan precies? En welke rol speelt de mens daarin? Aletta maakt daarvoor een helder onderscheid: tussen systemen die aanbevelen (recommender systems) en systemen die ondersteunen bij beslissingen (decision support systems).

- Een recommender system helpt je kiezen uit een grote hoeveelheid opties — zoals Spotify, Netflix of Booking. Er zijn ook wederkerige recommender systemen: je zoekt én wordt gezocht. Bijvoorbeeld bij Funda en datingsites.

- Bij een decision support system heb je een beperkt aantal opties en helpt het systeem bij het uitzoeken welke van die opties de beste keuze is. Als voorbeeld noemt Aletta navigatie. “Je kunt bijvoorbeeld zeggen: vermijd snelwegen, vermijd tol. Maar je hebt weinig controle. Je kunt algemene dingen kiezen, maar die zijn niet op mijn situatie van toepassing.”

In controle zijn

Controle is een belangrijke waarde voor hoe mensen met technologie omgaan. Maar dan wel échte controle. “Vaak wordt gesuggereerd dat er controle is, maar heb je het niet. Zoals bij de cookies op een website. Als je weigert, kun je de website vaak niet of maar deels gebruiken.”

Verschillende decision systemen

Volgens Aletta zijn er 2 verschillende decision support systems: rule-based en AI.

- Rule-based

Bijvoorbeeld het systeem van een bank dat bepaalt of iemand een lening mag krijgen. Eerst wordt gekeken naar het maandinkomen, dan naar de schuldenlast en dan naar de leeftijd. Zo’n systeem is transparant, uitlegbaar en deterministisch: voer je dezelfde gegevens in, dan krijg je altijd hetzelfde resultaat. - AI

AI leert uit miljoenen historische gegevens en gedragspatronen in plaats van vaste regels. Dat maakt het krachtiger, maar ook minder voorspelbaar. Het is vaak een black-box: je weet niet precies hoe de uitkomst tot stand komt, en elke keer dat je hetzelfde invoert, kan er een ander resultaat uitkomen.

3 niveaus van verantwoordelijkheid

Wat rule-based en AI gemeen hebben? Ze nemen allebei beslissingen die mensen raken. En juist daarom geldt, in de woorden van Aletta: “Welke tool je ook gebruikt, het moet verantwoordelijk zijn.” Maar wat betekent dat precies? Aletta onderscheidt 3 niveaus:

Technisch

Zijn de decision systemen goed gebouwd en beveiligd? Dat is de kern van technische verantwoordelijkheid. Persoonsgegevens mogen niet zomaar toegankelijk zijn, het systeem mag geen groepen uitsluiten of benadelen, en het moet controleerbaar zijn – ook buiten de ontwikkelaars om.

Interactioneel

Communiceert een decision systeem eerlijk, transparant en begrijpelijk? Dat is waar interactionele verantwoordelijkheid over gaat. Maar het gaat verder dan goede communicatie alleen — een AI moet toegankelijk zijn voor iedereen. Aletta: “Veel onderzoeken gaan over verhogen van precisie. Bedrijven zijn blij als ze 80% van de mensen bereiken. En dat is prima als het over aanbevelen van boeken of films gaat, maar niet echt lekker als het over opsporen van fraude of toewijzen van uitkeringen gaat.”

Contextueel

Houden de Rule-based en AI-systemen rekening met de wereld eromheen? Dat is de vraag achter contextuele verantwoordelijkheid. Een systeem moet passen bij de omgeving, de gebruiker en de maatschappij — en daar zijn concrete kaders voor, zoals de EU AI Act en GAFAI.

Je kunt het zien als drie lagen: de techniek, het gesprek, en de wereld eromheen.

Interactie tussen mens en algoritme

Vooral technische en contextuele verantwoordelijkheid worden momenteel veel onderzocht. Maar interactionele verantwoordelijkheid minder. En daar gaat juist veel onderzoek van Aletta over. Wat betekent interactionele verantwoordelijkheid in de praktijk. Aletta: “Interactionele verantwoordelijkheid gaat erom dat het algoritme transparant is. Het gaat om controle. En uitleg: ‘Je hebt geen recht op een uitkering en wel hierom’. De middelen waarmee je de gebruiker de mogelijkheid geeft om het algoritme te sturen heet ‘Algorithmic affordances‘.” Je kunt direct communiceren met het algoritme, over de input, over de output en het proces. Bijvoorbeeld bij een webwinkel kun je de resultaten sorteren op relevantie, populariteit, prijs en meer. Dat dit goed gebeurt, wordt steeds belangrijker.

De kwaliteit van dit ‘gesprek’ met het algoritme bepaalt of gebruikers het systeem vertrouwen, de tool blijven gebruiken en het gevoel hebben dat zij de regie hebben — en zich daardoor ook verantwoordelijk voelen voor de uitkomsten.

Eerlijke behandeling door algoritme

Een goed voorbeeld van een tool waarin de interactie tussen mens en algoritme goed geregeld is, is volgens Aletta ‘Tot uw dienst‘. Deze tool combineert de ID-wallet en de tool ‘Bereken je recht’. Als je je gegevens invult, zie je snel voor welke financiële voorzieningen je in aanmerking komt. Ook zie je wat de gevolgen zijn als je net iets anders invult. Het is transparant. Aletta: “Je krijgt dan het gevoel: ik ben eerlijk behandeld door het algoritme.”

Zo zou het altijd moeten zijn. Aletta is dan ook helder over wat er nog moet veranderen: “Mensen die geraakt worden door systemen, horen meegenomen te worden bij de ontwikkeling van dit systeem.” Want mens en algoritme — dat gesprek is nog lang niet klaar. De richting is helder: technologie die mensen centraal stelt, eerlijk is en toegankelijk voor iedereen.

Aletta Smits is lector Human-Centered Technology aan de Hanze Hogeschool Groningen en assistent-professor en docent Human-Computer Interaction aan de Universiteit Utrecht. Ze onderzoekt hoe digitale tools en AI-systemen zo ontworpen kunnen worden dat mensen centraal blijven staan. Op 27 maart 2026 verzorgde ze op de Gebruiker Centraal conferentie de expertsessie ‘Mens en algoritme: wie past zich aan wie aan?’ Samen met Gebruiker Centraal is ze momenteel bezig met een onderzoek naar de interactie tussen mens en algoritme.